実は、発注側の社内SEにとってのシステムテスト・UATは「業務が止まらないかどうか」を判定する最終審査です。ここで見逃すと、稼働後に現場が混乱するリスクがあります。

発注側のUATは、単なるバグ探しではなく「新しい仕組みで業務が正しく回るか」を判定する工程です。SIer・SESで経験した「仕様通りに動くかを確認するテスト」とは、目的も責任範囲も根本から異なります。

私は情シス部門で20年以上、テスト計画から稼働判定まで数多くのプロジェクトを主導してきました。この記事では、発注側の社内SEが担う主要業務と成功のコツを実務者の視点で解説します。

なお、本記事は「テスト・UAT フェーズ」に特化して仕事内容を紹介しています。工程全体の流れを知りたい方は以下も合わせて参照ください。

関連記事 社内SEの『業務システム担当』とは?

この記事を読めば、こんなことが分かります!

- システムテストとUATの定義と、それぞれの目的の違い

- 受注側と発注側で、役割と責任がどう変わるのか

- 発注側の社内SEが担うテスト・UATの主要業務5選

- 本番トラブルを防ぐ、UATを成功させる5つのコツ

システムテスト・UATで社内SEに求められる役割とは

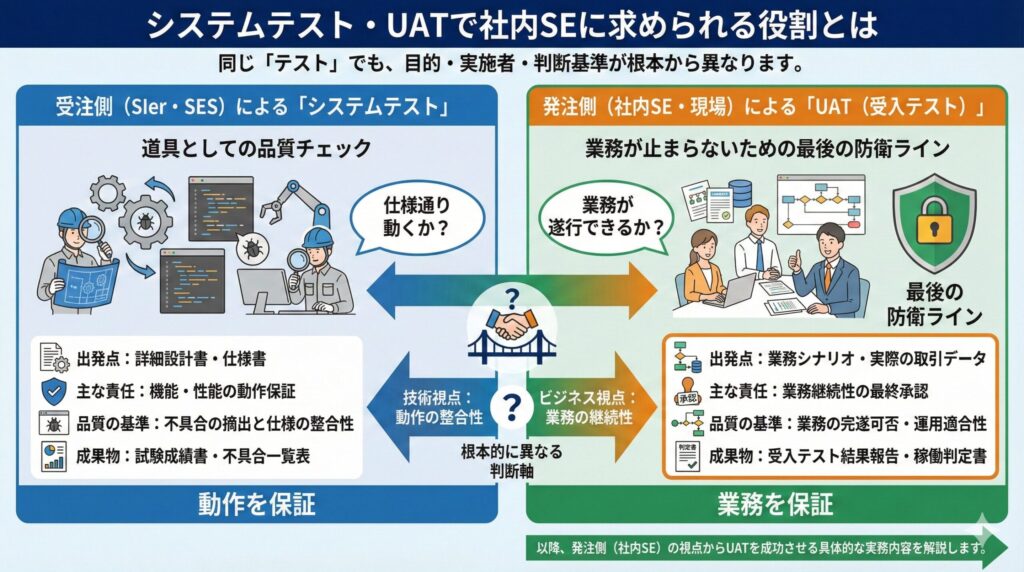

社内SEへの転職を機に、受注側のテスト工程とは何が変わるのかを整理しましょう。同じ「テスト」という言葉でも、目的・実施者・判断基準が根本から異なります。

システムテストとUATは何が違うのか

システムテストとは

システムテストとは、受注側が開発したシステムが設計仕様通りに動作するかを確認する工程です。

バグの摘出と仕様との整合性担保が主な目的で、実施主体は開発者やQAエンジニアです。「プログラムが正しく動くか」を検証する、道具としての品質チェックにあたります。

UATとは

UAT(User Acceptance Test=受入テスト)とは、発注側が実際の業務シナリオをもとに「この仕組みで業務が遂行できるか」を最終確認する工程です。

実施主体は発注側の社内SEと現場ユーザーです。「システムが動く」ことよりも「業務が止まらない」ことを品質の基準とする点が、システムテストとの本質的な違いです。稼働後にトラブルを未然に防ぐ、最後の防衛ラインと言えます。

受注側は動作を保証し、発注側は業務を保証する

受注側はシステムが設計図通りに動くことを保証します。一方、発注側の社内SEは自社の業務が継続できることを最終的に承認する立場です。責任の所在と判断軸が根本的に異なるため、担う実務の中身もまったく変わります。

- 出発点:詳細設計書・仕様書

- 主な責任:機能・性能の動作保証

- 品質の基準:不具合の摘出と仕様の整合性

- 成果物:試験成績書・不具合一覧表

- 出発点:業務シナリオ・実際の取引データ

- 主な責任:業務継続性の最終承認

- 品質の基準:業務の完遂可否・運用適合性

- 成果物:受入テスト結果報告・稼働判定書

以降では、発注側(社内SE)の視点からUATを成功させる具体的な実務内容を解説します。

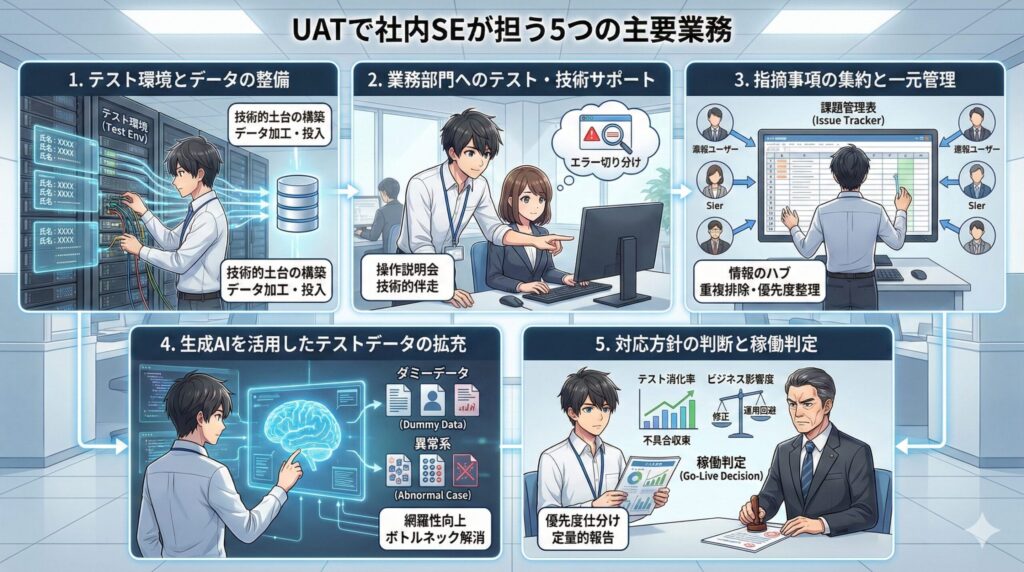

UATで社内SEが担う5つの主要業務

発注側の社内SEが担うテスト業務は、画面を操作して確認するだけではありません。UATを成立させるために社内SEが担う5つの役割を解説します。いずれも技術力よりも判断力と調整力が問われる業務です。

1. テスト環境とデータの整備

業務部門がUATをすぐに開始できるよう、システム環境とテストデータを整えるのが社内SEの最初の役割です。

業務部門は業務のプロですが、サーバーの準備や適切なデータの用意といった技術的な作業を単独で行うことは難しいからです。社内SEが技術的な土台を整えることで、業務部門は「業務フローの確認」に集中できます。

整備の具体例

- テスト環境の構築:本番と同等のサーバーを準備し、最新アプリケーションを正しく配置

- データの加工・投入:実績データを抽出し、個人情報をマスキングの上テスト環境へ投入

2. 業務部門へのテスト・技術サポート

テストを実行する業務部門に対して、システム操作や技術面での伴走サポートを行います。

新しいシステムの操作や予期せぬエラーへの対処は、業務部門だけでは判断が難しいからです。社内SEが技術的な壁を取り除くことで、テストが止まらずに前進します。

サポートの具体例

- エラーの切り分け:操作ミス・設定漏れ・不具合のいずれかを技術的に判定

- 操作説明会の実施:テスト開始前に基本操作をトレーニングし、シナリオ確認に集中できる状態を整備

3. 指摘事項の集約と一元管理

テスト中に上がる不具合報告や改善要望を社内SEが集約し、プロジェクト全体の課題状況を正確に管理します。

複数の参加者からバラバラに報告が上がると、重複や漏れが生じ現場が混乱するからです。

管理の具体例

- 報告フォーマットの統一:発生画面・操作手順・エラー内容を記録できる課題管理表を整備

- 重複の排除:同一の指摘をまとめ、対応優先度を整理して受注側(SIer・SES)へエスカレーション

社内SEが情報のハブとなることで、課題を漏れなく管理しプロジェクトを前に進められます。

4. 生成AIを活用したテストデータの拡充

個人情報の制約などで本番データが使えない場面では、生成AIでダミーデータを作成しテストの網羅性を高めます。

十分なテストには多様なデータが必要ですが、発生頻度の低い異常系データや機密情報を含むデータはそのまま使えないからです。

活用の具体例

- ダミーデータの生成:マスキング済みデータをもとにAIで多様なパターンを生成し、網羅的な検証を実施

- 異常系データの補完:実際には発生しにくい極端なケースをAIで作成し、テストシナリオの穴を補完

AIを活用することで「データが足りずテストが進まない」というボトルネックを解消できます。

5. 対応方針の判断と稼働判定

指摘事項への対応方針を決定し、経営層から稼働判定を獲得するのが発注側としての最終的な役割です。

全ての指摘を完璧に修正しようとすればリリースが遅れ、追加コストが発生するからです。「稼働前に直すか・後日対応か・運用でカバーするか」をビジネス影響度で判断することが求められます。

判断と稼働判定の具体例

- 優先度の仕分け:金額計算の誤りは「稼働前必須」、ボタンの文言変更は「後日対応」と割り切る

- 定量的な報告:テスト消化率や不具合収束状況をグラフ化し、経営層が判断できる根拠を提示

残課題と対応策をセットで示すことが、稼働判定獲得の鍵です。

本番トラブルを防ぐUAT成功の5つのコツ

主要業務をこなすだけでなく、プロジェクトの品質をさらに高めるコツを押さえておきましょう。現場で実際に効果のあった5つのポイントを解説します。

1. 異常系・境界値を徹底的に叩く

受注側のシステムテストは正常な動作の確認が中心になりがちです。しかし本番では、正常系では見えないパターンが頻発します。

設計者が想定しなかった操作や入力値を意図的に試すことで、稼働後の事故を未然に防げます。

検証パターンの具体例

- 重複操作の点検:処理実行中に「戻る」や「更新」ボタンを連打した際の挙動確認

- 異常値の入力テスト:過去日・未来日・文字数上限など、境界付近の入力値でのエラー判定を検証

「システムを壊すつもり」で挑むことが、結果として頑丈な仕組みを作る近道です。

2. 初心者目線で操作性を点検する

設計者は無意識に正しい操作を選びますが、初心者は熟練者には見えない落とし穴にはまります。

仕様を熟知した社内SEだけでテストを完結させず、システムに不慣れなユーザーにも参加してもらうことで、分かりにくい箇所をこの段階で洗い出せます。

点検項目の具体例

- マニュアルの適合性確認:専門用語を使わず、新人でも手順通りに業務を完遂できるかをチェック

- UIの視認性評価:必須入力項目の分かりやすさ、ボタン名称と業務実態の乖離がないかを点検

「誰でも迷わず使えること」を確認するこの工程が、稼働後の問い合わせ対応の負担を大きく減らします。

3. 生成AIでテストパターンを洗い出す

人間だけでは思いつきにくい条件や極端な状況を、AIは網羅的に列挙できます。白紙から考えるより、AIが提示した候補を取捨選択する方が、検証漏れを大幅に減らすことができるからです。

活用例

- ダミーデータの生成:本番環境の特性を模した多様なパターンの検証用データを短時間で作成

- 網羅性チェック:作成済みのテスト計画に対し、不足している観点をAIに指摘させて精度を向上

4. 受注側の試験結果から隠れたリスクを見抜く

受注側(SIer・SES)から提出される試験結果の報告書を鵜呑みにせず、不具合の傾向を分析することが重要です。

特定の機能に不具合が集中している場合、その箇所の設計に根本的な問題が潜んでいる可能性があります。表面的な数値ではなく、不具合の分布や試験の密度から品質を読み解く目利き力が発注側には求められます。

目利き力の具体例

- 不具合曲線の確認:試験終盤でも不具合が出続けている場合、品質が安定していないリスクを特定

- 試験密度の点検:複雑な処理の割に試験項目が少ない箇所を見つけ出し、追加検証を指示

受注側の成果物を正しく評価し、不透明な部分を追求することが発注側としての重要な品質管理責任です。

5. 「後から直す範囲」を事前に合意する

全ての修正が完了するまでリリースを待てば、事業上の機会損失や追加費用が発生します。

稼働を優先すべき場面では、不備の影響範囲と対応時期を関係者で明確にした上で前進することがプロジェクトを成功に導きます。

判断と調整の具体例

- 回避策の提示:不具合がある機能を一時的に閉鎖し、代替の手作業フローをユーザーへ周知

- 残課題リストの共有:「いつまでに直すか」のスケジュールを明示し、現場の不安を解消した上で稼働へ

関係者を動かして内容を確定させる力こそ、社内SEが持つべき真の市場価値です。

まとめ:社内SEがUATで押さえるべきポイント

社内SEにとってのシステムテスト・UATは、自社のビジネスが滞りなく動くことを最終保証する、責任ある重要な仕事です。

- 役割の転換:「動作を確認する」受注側の視点から、「業務継続性を保証する」発注側の視点へ切り替える

- 主要業務:環境整備・技術サポート・課題管理・AIの活用・稼働判定の5つが核心

- 成功の鍵:例外ケースの徹底検証と、生成AIを活用した検証漏れの排除

- 判断力の重要性:技術力だけでなく、関係者を動かす調整力と合意形成力が社内SEの市場価値を高める

今の仕事で「バグを直すだけの作業」に物足りなさを感じているなら、品質の責任者として判断を下す社内SEは魅力的な挑戦です。技術の知識をビジネスを守る楯として使い、ユーザーからの確かな信頼を勝ち取ってみませんか。

よくある質問(FAQ)

Q1. ユーザーが協力してくれない時は?

まず「なぜテストに参加してほしいのか」を丁寧に伝えることが、協力を引き出す第一歩です。

ユーザーがテストへの参加を渋る背景には、「自分たちの仕事が増える」という不安が潜んでいることがほとんどです。まず不安の根本に向き合い、巻き込む姿勢で臨むことが重要です。

協力を引き出すための伝え方

・「稼働後に使いにくい画面があっても修正が難しくなる。今の意見が一番反映されやすい」と伝える

・繁忙期を避けてスケジュールを組み、1回あたりの拘束時間を明示して負担感を下げる

ユーザーを動かす調整力こそ、社内SEの真価が問われる場面です。この壁を越えられるかどうかが、テストの完成度を左右します。

Q2. システムテストとUATの違いを説明するには?

「道具として正しく動くか(受注側)」と「仕事で使いこなせるか(発注側)」という対比を使うと、技術に詳しくない相手にも伝わりやすいです。

技術用語を使わず、業務上の目的の違いに言い換えることで、現場ユーザーや経営層が自分ごととして理解できるからです。

対比フレーズの使い方

・整備士が出荷前に点検する(システムテスト)vs ドライバーが実際に乗って確かめる(UAT)

・受注側はプログラムの正確さを、発注側は業務の完遂を保証する

この説明を使いこなせると、ステークホルダーとの認識合わせがスムーズになります。

Q3. 生成AIでテスト工程を効率化する方法は?

AIにたたき台を作らせ、それをユーザーに確認・修正してもらうスタイルが最も効果的です。

人は白紙より目の前の案に意見を出す方が得意です。「60点の答案を直してもらう」スタイルに切り替えることで、検討スピードが格段に上がります。

たたき台として渡す具体例

・テストシナリオの初稿:業務内容を入力し、操作手順や例外パターンの一覧を出力させる

・ダミーデータの初版:本番データの構造を渡し、多様なパターンのダミーデータを生成させる

たたき台さえ用意できれば、ユーザーは「ここが足りない」「この条件も必要」と具体的な意見を出しやすくなります。

Q4. 致命的な不具合をリリース直前に見つけた時は?

「業務継続性」と「データの整合性」への影響度を判断軸に、稼働判定を行います。

業務全体に影響するなら稼働延期、個別で回避できるなら稼働優先と判断します。経営層を交えて判断を確定させることが重要です。

判断の目安

・稼働延期:データ破損リスクが1%でもある場合

・予定通り実施:操作が一部煩雑だが、代替手順をマニュアルで周知できる場合

曖昧にせず判断を確定させることが、発注側の社内SEとしての責務です。

Q5. 見きれなかった不具合の責任範囲は?

受注側(SIer・SES)は修正責任を、発注側の社内SEは影響管理の責任を担います。

受注側は仕様書に定められた動作を保証する立場であり、そのシステムで自社のビジネスが成立するかどうかまでは負えません。

責任範囲の具体例

・受注側(SIer・SES):不具合を修正し、再テストで品質を復旧

・発注側(社内SE):業務への影響を評価し、暫定フローと再発防止ルールを策定

責任範囲を把握していれば、稼働後のトラブル対応で役割の混乱が起きません。

この記事で使われている専門用語の解説